AI, soldi, truffe… e quando tocca proprio a te..

Qualche sera fa ero sul divano, con Allegra impegnata a smontare il telecomando e Beatrice convinta di poter scalare il tavolino, mentre dall’app della banca stavo impostando il solito PAC per il loro “portafoglio del futuro”.

A un certo punto l’app mi propone in automatico una nuova soluzione “personalizzata”, basata “sul mio profilo di spesa”.

E lì mi è scattata la domanda:

ma quanta Intelligenza Artificiale c’è oggi dietro la nostra banca… e quanto è davvero dalla nostra parte ?

Domanda che mi è tornata in testa ancora più forte visto che qualche giorno fa mi sono ritrovato:

- a farmi aiutare a leggere una mail di data breach di un’azienda (Poltronesofà) da cui avevo comprato un divano,

- e poco dopo a riceverne un altra da Iberia, entrambe per la stessa storia: “c’è stato un attacco hacker, alcuni tuoi dati personali potrebbero essere stati rubati”.

Quando succede una volta ti arrabbi.

Quando succede due, tre volte in poche settimane, ti rendi conto che questo non è più un incidente: è il nuovo “rumore di fondo” della nostra vita digitale. E nel mezzo ci sono le banche, i nostri soldi e un bel po’ di AI.

In questo articolo provo a mettere ordine, da semplice cliente curioso e da papà, non da tecnico.

Che cos’è l’AI in banca (spiegata semplice)

L’Intelligenza Artificiale, in pratica, è un insieme di sistemi che imparano dai dati e prendono decisioni o propongono azioni che somigliano a quelle umane:

- riconoscono pattern,

- stimano probabilità,

- fanno previsioni,

- generano contenuti (testi, immagini, voce…).

Negli ultimi anni abbiamo sentito parlare soprattutto di Generative AI (gli strumenti tipo ChatGPT, per capirci), ma nel mondo bancario l’AI “meno visibile” è entrata da tempo: nei modelli di rischio, nell’analisi delle transazioni, nelle decisioni di credito.

Secondo un’analisi pubblicata a settembre 2025, il 92% delle banche europee usa già l’AI in produzione, e l’8% restante sta testando casi d’uso: dalla profilazione dei clienti alla rilevazione delle frodi.

Tradotto: praticamente tutte le banche, dietro le quinte, stanno già facendo lavorare algoritmi sui nostri dati.

Dove (già oggi) la usano le banche

Provo a riassumere gli usi principali in cose che ci toccano davvero.

1. Offerte e servizi sempre più “su misura”

L’AI analizza:

- entrate e uscite,

- abitudini di spesa,

- prodotti che abbiamo,

- età, situazione familiare, storico dei nostri investimenti.

Con questi dati può:

- suggerire piani di risparmio e prodotti “tagliati su di noi”,

- proporre di aumentare o ridurre il rischio degli investimenti,

- mandarci notifiche ultra-mirate nell’app.

Per la banca è un modo per vendere meglio.

Per noi può essere utile, a patto di ricordarci che è una proposta commerciale, non un consiglio neutrale.

2. Valutazione del credito e scoring

Qui l’AI entra nei sistemi che decidono se:

- concederti un prestito,

- a che condizioni,

- con che tasso.

Sono modelli che macinano dati su:

- storico dei pagamenti,

- situazione lavorativa,

- comportamento sul conto,

- eventuali ritardi o sconfinamenti.

Per questo, nel nuovo AI Act europeo, i sistemi di AI usati per il credit scoring sono classificati come “ad alto rischio”: proprio perché possono decidere, di fatto, chi può accedere al credito e chi no.

Questo comporta:

- requisiti più severi sulla qualità dei dati,

- test di accuratezza e di bias,

- obblighi di documentazione e controllo umano.

3. Anti-frode e sicurezza

Qui l’AI è veramente una delle armi più importanti.

Algoritmi di machine learning analizzano in tempo reale milioni di transazioni e cercano anomalie:

- pagamenti da paesi dove non sei mai stato,

- importi fuori dal tuo standard,

- combinazioni strane di device, IP, orari.

È grazie a questi sistemi se a volte ci troviamo la carta bloccata “in anticipo”, prima ancora di accorgerci di un utilizzo sospetto.

Le autorità e gli osservatori del settore mettono sempre più spesso il fraud detection al primo posto tra gli usi dell’AI in banca: prevenzione delle frodi, antiriciclaggio, controlli KYC (Know Your Customer).

4. Chatbot, assistenti virtuali e automazione interna

- bot che rispondono H24,

- sistemi che compilano documenti,

- strumenti che aiutano i consulenti a trovare in pochi secondi le info giuste.

Tutto questo è già AI.

Molto spesso noi vediamo solo l’interfaccia carina dell’app, ma dietro ci sono modelli che smistano richieste, leggono PDF, classificano mail, segnalano anomalie.

Il lato oscuro: deepfake, truffe e data breach

Il problema è che gli stessi mattoncini tecnologici che rendono più intelligente la banca, rendono anche più credibili e pericolose le truffe.

Gli esempi ormai abbondano:

- A Hong Kong, un dipendente è stato convinto durante una video-call a trasferire circa 20 milioni di sterline: le persone in call sembravano i suoi veri capi, ma erano deepfake generati con l’AI.

- Nel 2024, la società di ingegneria Arup è stata truffata per 25 milioni di dollari dopo una videoconferenza intera popolata da finti dirigenti generati dall’AI.

Questi casi non sono leggende metropolitane: sono entrati nei report ufficiali, nei giornali, nei documenti di awareness sulla cyber-sicurezza.

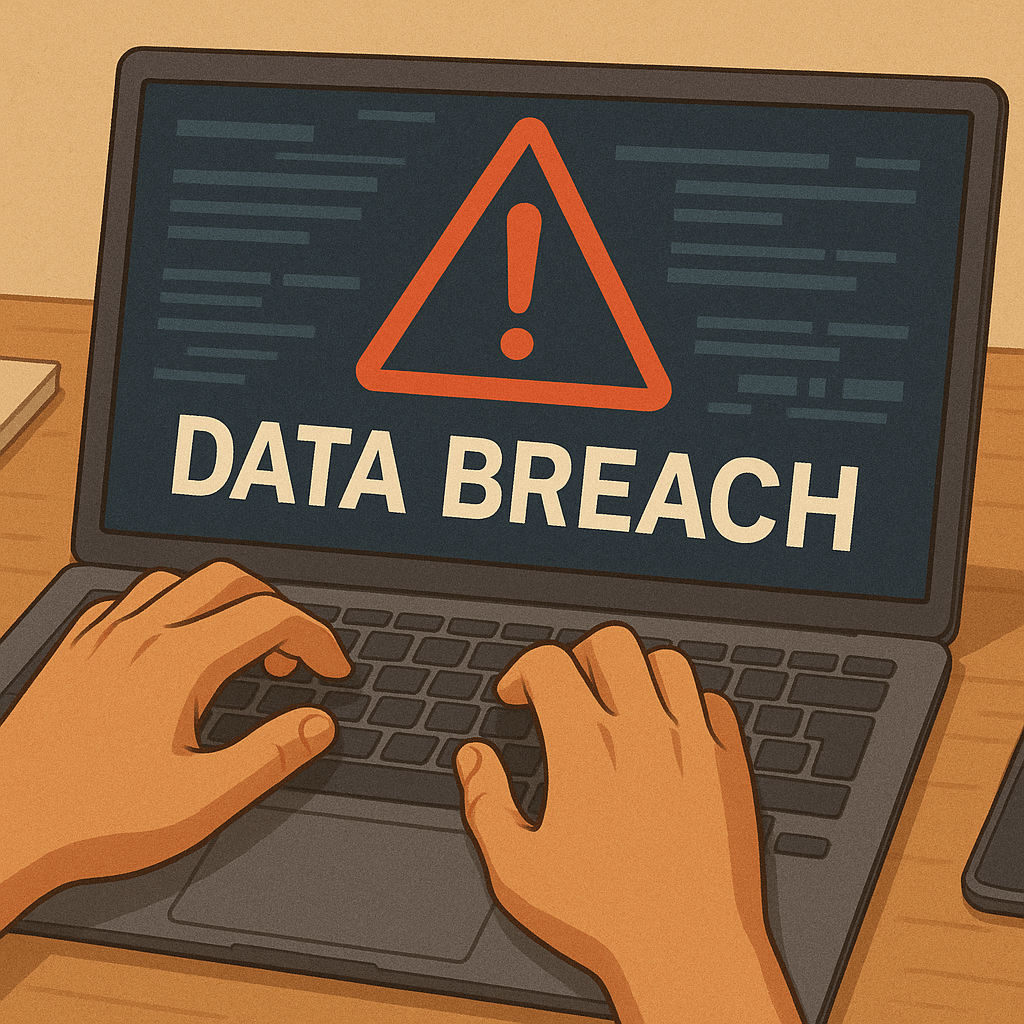

E poi ci sono i data breach, quelli che arrivano dritti nella nostra casella mail.

Quando il data breach arriva a casa tua

Nel giro di poche settimane mi è successo questo, in concreto:

- ho ricevuto una mail ufficiale da Poltronesofà che mi informava di un attacco informatico ai loro sistemi, con la possibilità che alcuni miei dati personali fossero finiti in mano a terzi;

- poco dopo, una comunicazione simile da Iberia, di nuovo per un problema di sicurezza informatica e furto di dati.

Non parliamo di “cose tecniche” astratte.

Parliamo di:

- dati di contatto,

- cronologia acquisti o viaggi,

- in alcuni casi anche estremi di pagamento,

che finiscono in database che non dovrebbero esistere.

Sono arrivato al punto di scrivere a una di queste aziende per chiedere un riconoscimento economico per il disagio: non perché i soldi risolvano il problema, ma perché è l’unico modo che abbiamo, da clienti, per far capire che queste cose non sono normali.

E il paradosso è questo: le banche usano l’AI per proteggersi e proteggerci, ma allo stesso tempo viviamo in un ecosistema digitale in cui:

- i nostri dati viaggiano dappertutto,

- qualsiasi azienda può diventare un punto debole,

- e una fuga di dati da una parte può trasformarsi in truffe molto credibili dall’altra (mail, telefonate, finti operatori della banca che “sanno tutto di noi”).

Cosa sta facendo l’Europa (AI Act, EBA & co.)

L’Unione Europea non è rimasta ferma.

- Il 1° agosto 2024 è entrato in vigore l’AI Act, il primo grande regolamento al mondo dedicato all’Intelligenza Artificiale.

- Il regolamento vieta alcune forme di AI considerate a rischio inaccettabile (tipo il social scoring alla “punteggio sociale”), e regola in modo molto stretto i sistemi ad alto rischio – tra cui rientrano molti casi d’uso nel mondo finanziario.

- L’Autorità Bancaria Europea (EBA) ha mappato gli usi dell’AI nel settore bancario e nei pagamenti, evidenziando che il grosso dei casi d’uso riguarda proprio:

- rilevazione delle frodi,

- antiriciclaggio,

- credit scoring,

- profilazione dei clienti.

L’idea di fondo è sì all’innovazione, ma con:

- trasparenza su come vengono prese certe decisioni automatizzate,

- requisiti minimi su qualità dei dati e test dei modelli,

- possibilità per il cliente di avere spiegazioni e, se serve, contestare.

E noi, cosa possiamo fare (davvero) da clienti?

Ok, tutto bello a livello macro, ma nel pratico ?

Io mi sono dato alcune regole molto semplici, nate anche dalle ultime esperienze con i data breach e dalle storie che leggo sui deepfake:

- Mai dare codici o OTP al telefono o via chat

La banca non li chiede. Punto.

Se qualcuno lo fa, anche se la voce sembra “giusta”, chiudo e richiamo io il numero ufficiale. - Diffidare delle urgenze emotive

- “Se non paghi entro 10 minuti blocchiamo il conto”

- “Se non fai subito il bonifico lui finisce nei guai”

Sono script studiati per farti reagire senza pensare. Mi prendo 5 minuti, respiro, verifico da un altro canale.

- Non cliccare al volo su link anche se la mail sembra vera

Soprattutto dopo i data breach: se ricevo una mail “della banca” che mi chiede di fare login, non clicco dal link. Apro l’app o digito io il sito. - Condividere meno dati personali del necessario sui social

I nomi delle figlie, la città, i dettagli di viaggio, le foto della casa: tutto può essere usato per rendere più credibile una truffa. - Attivare alert e notifiche su conti e carte

Ogni pagamento sopra una certa soglia → notifica sul telefono.

Così, se qualcosa non torna, lo vedo subito. - Aggiornare app, sistemi operativi e password

Noioso ? Sì.

Ma è una delle difese più semplici contro tanto schifo là fuori. - Chiedere, chiedere, chiedere

Al consulente, allo sportello, via mail:- come usate l’AI ?

- potete spiegarmi perché ho ricevuto questa proposta ?

- c’è sempre un umano che può intervenire sulle decisioni dell’algoritmo ?

Non è essere paranoici, è essere consapevoli.

Conclusione: tra entusiasmo, rabbia e responsabilità

Io lo dico senza vergogna: l’AI mi affascina.

La uso per scrivere, per capire, per lavorare meglio.

E, sì, la sto usando anche per progettare un futuro un po’ più sereno per Allegra e Beatrice.

Ma proprio perché ci credo, non ho nessuna voglia di subirla a occhi chiusi.

Quando nel giro di poche settimane:

- vieni a sapere che i tuoi dati sono in giro per colpa di un attacco hacker,

- leggi di aziende che perdono milioni per una video-call deepfake,

- e ti trovi un’app bancaria che “ti conosce meglio di te”,

capisci che questa partita non è solo tecnologica: è di fiducia, trasparenza e responsabilità.

Le banche stanno diventando sempre più intelligenti.

La domanda vera è: noi vogliamo restare clienti passivi o diventare utenti consapevoli ?

Io, nel mio piccolo, scelgo la seconda.

E spero che, quando un giorno le mie gemelle apriranno il loro primo conto, troveranno banche:

- sì, piene di AI,

- ma anche capaci di spiegare,

- pronte ad assumersi le responsabilità quando sbagliano,

- e abbastanza serie da trattare i nostri dati come qualcosa di più di un semplice “Asset”.

La verità che ci resta in tasca è a mioo avviso una sola:

Più condividiamo esperienze reali, più diventiamo difficili da fregare.

Grazie, un vademecum utile.

Anche per chi come me crede di essere abbastanza “corazzato”.

"Mi piace"Piace a 1 persona